保険代理店や建設業 の方からの問い合わせを多く受けますが、「顧客対応の効率化」と「正確な情報提供」は大きな課題です。

TAYURA Muse の RAG(Retrieval-Augmented Generation) は、社内資料・契約書・マニュアルを読み込み、AIが即座に回答するチャットボットを公式サイトに簡単に設置できる仕組みを提供します。

FAQ対応や一次問い合わせを自動化し、24時間365日、御社の「AI窓口」として稼働します。

本記事では、実際の設定画面を交えながら、RAGの導入手順を 3ステップ で解説します。

RAGを公式サイトに導入するメリット

-

顧客からの問い合わせを24時間自動対応

-

サービス内容や契約に関する質問に即答

-

担当者の対応負担を大幅に削減

-

-

社内資料を活用した正確な回答

-

マニュアルや約款をナレッジベースに取り込むだけで、AIが回答

-

情報の更新も簡単に反映可能

-

-

営業・サポート部門の効率化

-

FAQや一次対応をAIがカバー

-

担当者はコア業務に集中できる環境を実現

-

ステップ1:情報を登録する(ナレッジベース作成)

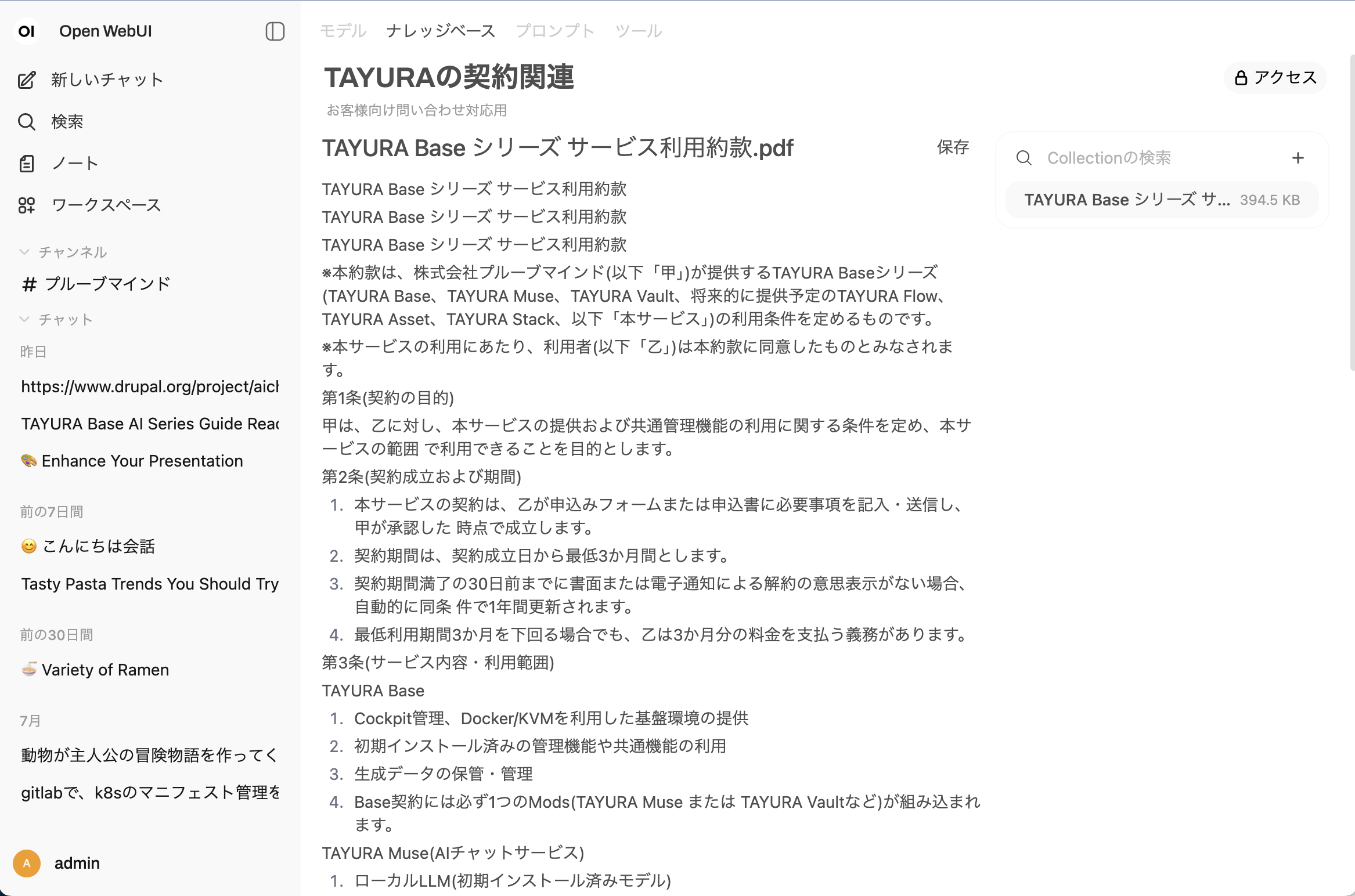

まずは、Open WebUI(TAYURA Muse)でナレッジベースに資料を登録します。

手順

-

ナレッジベース一覧で 「+」ボタンをクリック

-

名称や利用目的を入力し、「作成」を選択

-

PDFやテキストをドラッグ&ドロップで取り込み

-

「保存」で登録完了

👉 契約書・社内マニュアル・FAQ資料など、日常的に利用する文書をそのまま活用できます。

ステップ2:モデルを設定する(チャットボット作成)

次に、チャットボットの会話スタイルを定義します。

設定例

-

モデル名: TAYURA Base 問い合わせ対応

-

モデルID: tayura-faq

-

ベースモデル: gpt-4o-mini

-

システムプロンプト例:

あなたは親切なエージェントです。常にわかりやすい日本語で回答してください。

-

ナレッジベース: TAYURAの契約関連

「保存して作成」をクリックすれば準備完了です。

実運用時の注意点:応答が遅くなるケース

TAYURA Muse はローカルLLMでも利用可能ですが、

RAG検索やMCP(外部サービス連携)を組み合わせると応答が極端に遅くなる 場合があります。

遅延が発生しやすい例

-

ナレッジベース検索 + PDF要約

-

ナレッジベース検索 + 外部API呼び出し(例:カレンダー、CRM)

-

大規模ファイルを読み込んだ状態での複数質問

👉 この場合、応答までに 30秒〜1分以上かかる こともあります。

回避策

-

FAQや顧客対応のように応答速度が重要なケースでは、

OpenAI APIモデル(gpt-4o / gpt-4o-mini など) の利用を推奨

-

ローカルLLMは「機密性重視の社内利用」や「簡易QA」に最適

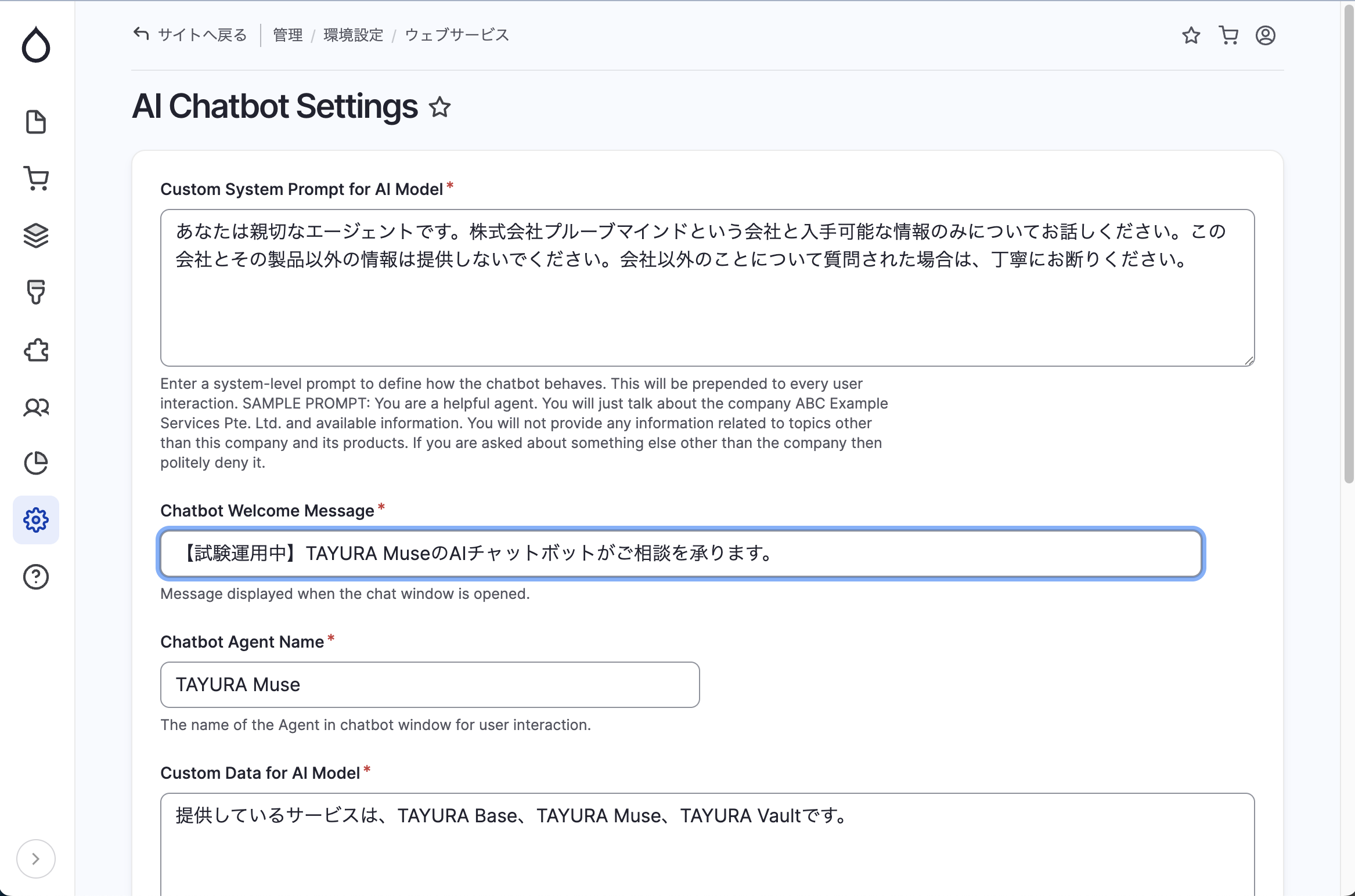

ステップ3:公式サイトにチャットボットを設置する

作成したチャットボットを公式サイトへ埋め込みます。

3.1 認証情報の取得

- Open WebUIのアカウント設定から APIキー(JWTトークン) を取得

3.2 Drupalへの接続設定

-

「AI Chatbot」モジュールをインストール

-

API URL・APIキー・モデルIDを入力

-

システムプロンプトで回答スタイルをカスタマイズ

👉 これだけで、公式サイトにRAG対応チャットボットを即設置できます。

導入後の効果

-

士業事務所:契約関連の問い合わせをAIが即時回答 → 業務時間を削減

-

保険代理店:商品説明や約款内容のFAQ対応を自動化 → 担当者は営業活動に集中

-

建設業:社内マニュアルや安全規則の問い合わせをAI対応 → 作業効率と安全性の両立

まとめ:公式サイトに「AI窓口」を置く時代へ

TAYURA Muse の RAGを活用すれば、

-

FAQや契約に関する質問を 24時間365日自動受付

-

社内資料をベースにした 正確な回答を即時提供

-

営業・サポート部門の 大幅な負担軽減

を一度に実現できます。

公式サイトに置くだけで動く「AI窓口」、ぜひ体験してみてください。